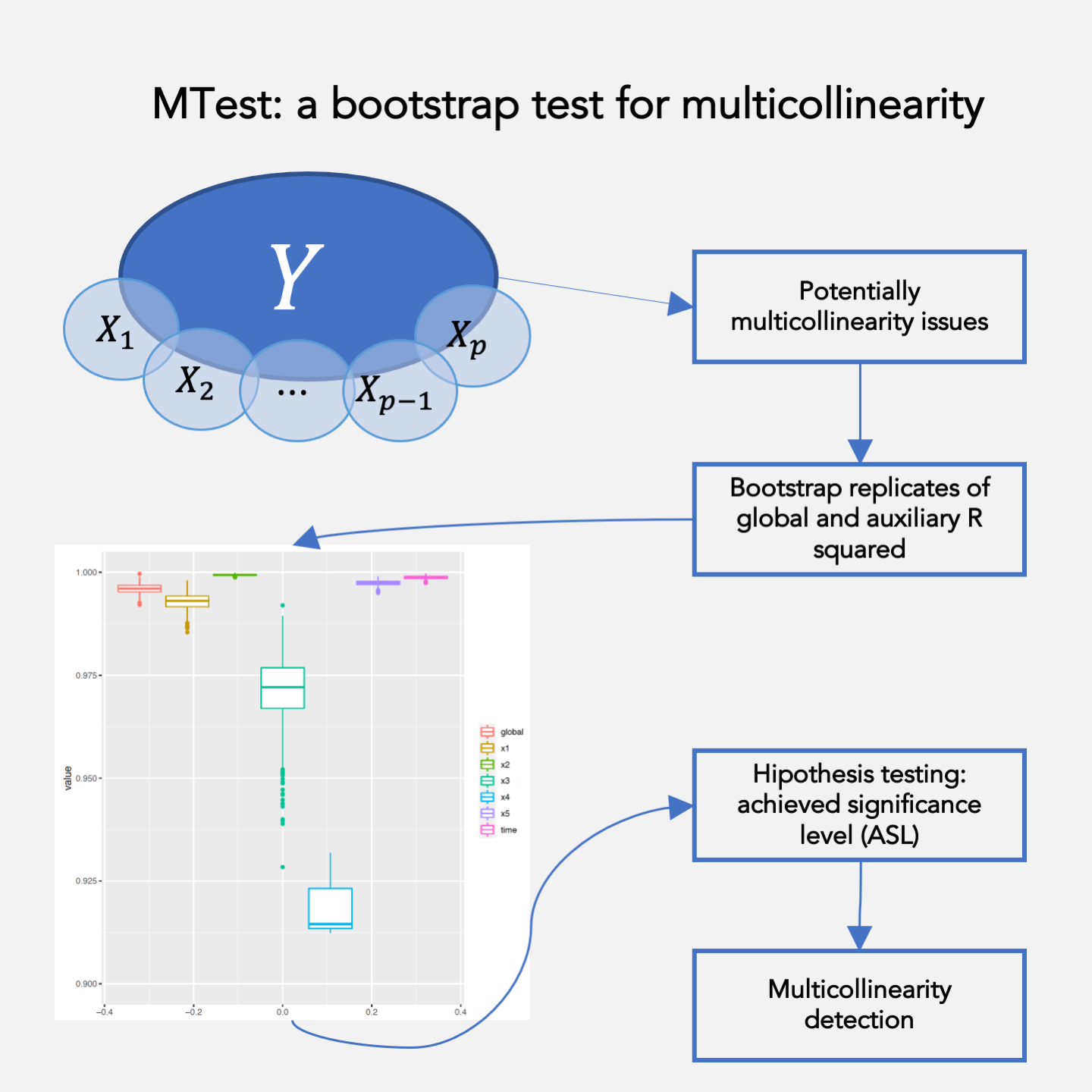

MTest: una Prueba bootstrap para Multicolinealidad

##plugins.themes.bootstrap3.article.main##

Resumen

Se propone una prueba no paramétrica basada en bootstrap para detectar multicolinealidad: MTest. Esta prueba brinda soporte estadístico a dos de los métodos más famosos para detectar multicolinealidad en trabajo aplicado: la regla de Klein y el Factor de Inflación de Varianza (VIF por multicolinealidad esencial). Como parte del procedimiento, MTest genera una distribución bootstrap para el coeficiente de determinación que: i) permite al investigador evaluar la multicolinealidad al establecer una significancia estadística "alfa", o más precisamente, un nivel de significancia alcanzado (ASL) para un umbral dado, ii) utilizando una prueba de Kolmogorov-Smirnov (KS) por parejas, establece una guía para una eliminación informada de las variables que están causando multicolinealidad. Para mostrar los beneficios de MTest, el procedimiento se implementa computacionalmente en una función para modelos de regresión lineal. Esta función se prueba en experimentos numéricos que coinciden con los resultados esperados. Finalmente, este documento hace una aplicación de MTest a datos reales que se sabe que tienen problemas de multicolinealidad y detecta con éxito la multicolinealidad con un ASL dado.

Descargas

Descargas

Detalles del artículo

Citas

Achen, C. H. (1982). Interpreting and using regression. Sage.

Carrodus, M. L. and Giles, D. (1992). The exact distribution of R2 when the regression disturbances are autocorrelated. Economics Letters, 4(38), 375-380. https://doi.org/10. 1016/0165-1765(92)90021-P

Dinov, I. D. (2016). Methodological challenges and analytic opportunities for modeling and interpreting Big Healthcare Data.Gigascience, 5(1). https://doi.org/10. 1186/s13742-016-0117-6

Efron, B. (1992). Bootstrap methods: another look at the jackknife. Breakthroughs in statistics (pp. 569-593). Springer, New York, NY. https://doi.org/10.1214/aos/ 1176344552

Farrar, D. E. and Glauber, R. R., (1967). Identities for negative moments of quadratic forms in normal variables. The Review of Economic and Statistics, 49, 92-107. https: //doi.org/10.1016/j.spl.2008.12.004

Fox, J. and Weisberg, S. (2019). An R Companion to Applied Regression, Third Edition. Thousand Oaks CA: Sage. https://socialsciences.mcmaster.ca/ jfox/Books/Companion/

Godfrey, L. (2009). Bootstrap tests for regression models. Springer.

Gujarati, D. N. and Porter, D. C. and Gunasekar, S., (2012). Basic econometrics). McGraw-Hill, United States.

Horowitz, J. L. (2001). The bootstrap. In Handbook of econometrics (Vol. 5, pp. 3159-3228). Elsevier.

Imdadullah, M. and Aslam, M. and Altaf, S. (2016). mctest: An R Package for Detection of Collinearity among Regressors. textitThe R Journal, 8(2), 499–509. https://doi.org/ 10.32614/RJ-2016-062

Jaya, I. G. N. M. and Ruchjana, B. and Abdullah, A. (2020). Comparison Of Different Bayesian And Machine Learning Methods In Handling Multicollinearity Problem: A Monte Carlo Simulation Study. ARPN J. Eng. Appl. Sci, 15(18), 1998-2011.

Klein, L.R. (1962). An Introduction to Econometrics. Prentic-Hall, Englewood, Cliffs, N. J, 101.

Koerts, J. and Abrahamse, A. P. J. (1969). On the theory and application of the general linear model. Rotterdam University Press.

Leamer, E. E., (1983). Model choice and specification analysis. Handbook of econometrics, 1, 285-330.

Longley, J. W. (1967). An appraisal of least squares programs for the electronic computer from the point of view of the user. Journal of the American Statistical association, 62(319), 819-841. https://doi.org/10.1080/01621459. 1967.10500896

Marcoulides, K. M. and Raykov, T. (2019). Evaluation of variance inflation factors in regression models using latent variable modeling methods. Educational and psychological measurement, 79(5), 874-882. https://doi.org/10. 1177/0013164418817803

Salmerón-Gómez, R. and García-García, C. and García-Pérez, J. (2018). Variance Inflation Factor and Condition Number in multiple linear regression. Journal of Statistical Computation and Simulation, 88(12), 2365-2384. https: //doi.org/10.1080/00949655.2018.1463376

Salmerón-Gómez, R. and García-García, C. and García-Pérez, J. (2020). Detection of Near-Multicollinearity through Centered and Noncentered Regression. Mathematics, 8(6), 931- 948. https://doi.org/10.3390/math8060931

Salmerón-Gómez, R. and García-García, C. and García-Pérez, J. (2021a). Obtaining a threshold for the Stewart index and its extension to ridge regression. Computational Statistics, 36, 1011–1029. https://doi.org/10.1007/ s00180-020-01047-2

Salmerón-Gómez, R. and García-García, C. and García-Pérez, J. (2021b). A guide to using the r package “multicoll” for detecting multicollinearity. Computational Economics, 57(2), 529-536. https://doi.org/10.1007/s10614-019-09967-y

Stein, M.L., (1975). The detection of multicollinearity: A comment. The Review of Economics and Statistics, 366-368. https://doi.org/10.2307/1923926

The World Bank, (2021). World Development Indicators. https://data.worldbank.org/ Accessed: 2010- 11-16.

Venables, W. N. and Ripley, B. D. (2002) Modern Applied Statistics with S. Fourth Edition. Springer, New York. ISBN 0-387-95457-0